על תופעת ה Grokking

- shlomoyona

- Apr 17

- 11 min read

הזכרתי את תופעת ה- Grokking בפוסט אחר שבו גם הסברתי על Model-wise Double Descent וגם על תופעת ה- Epoch-wise Double Descent. אפילו השוויתי בין התופעות. מדובר כידוע באחת התגליות המרתקות, המפתיעות והלא-אינטואיטיביות ביותר שנצפו בלמידת מכונה בשנים האחרונות.

תופעת ה-Grokking בלמידת מכונה התגלתה ופורסמה לראשונה בתחילת שנת 2022 על ידי קבוצת חוקרים ממעבדת הבינה המלאכותית OpenAI. הגילוי הוצג במאמר המדעי שנושא את השם Grokking: Generalization Beyond Overfitting on Small Algorithmic Dataset. צוות החוקרים שהוביל את העבודה כלל את אלתיאה פאוור, יורי בורדה, הארי אדוארדס, איגור בבושקין וודאנט מיסרה.

התופעה התגלתה במקרה כאשר החוקרים אימנו מודלים מסוג Transformer על משימות אלגוריתמיות פשוטות, כמו חשבון מודולרי. הם הבחינו כי לאחר שהמודל הגיע למצב של התאמת יתר, שבו הוא זכר את התשובות בעל פה אך נכשל בפתרון שאלות חדשות, המשך אימון ממושך ואינטנסיבי הוביל לשינוי פתאומי ודרמטי. בנקודה מסוימת, הדיוק של המודל על נתונים חדשים זינק לאזור ה-100%, מה שמעיד על כך שהמודל עבר מהסתמכות על זיכרון להבנה של החוקיות המתמטית העמוקה.

המונח Grokking נטבע לראשונה בהקשר זה על ידי אותם חוקרים מ-OpenAI, אשר שאלו אותו מספרו של סופר המדע הבדיוני רוברט היינליין, גר בארץ נוכריה. בספר, המילה מתארת הבנה כה עמוקה ומוחלטת של נושא מסוים, עד שהוא הופך לחלק מהמבין עצמו. החוקרים מצאו שזהו התיאור המדויק ביותר לרגע שבו המודל מפסיק לנחש סטטיסטית ומתחיל להבין את המבנה הלוגי של הבעיה.

ניסיון להסביר מה ולמה

אזכיר ש-בתהליך אימון טיפוסי, הכלל המנחה הוא עצירה מוקדמת: אנו עוצרים את האימון כאשר שגיאת האימון יורדת אל עבר האפס ושגיאת הוולידציה מתחילה לעלות, מתוך מחשבה שהמודל מתחיל לשנן נתונים (התאמת-יתר) ולא יצליח להכליל יותר. אולם, בגרוקינג הרשת אכן משננת תחילה את נתוני האימון בצורה עיוורת (שגיאת אימון 0, שגיאת וולידציה גבוהה מאוד), אך אם ממשיכים לאמן את המודל זמן רב מאוד, הרחק מעבר לנקודה שבה נדמה שהלמידה הסתיימה, שגיאת הוולידציה צונחת בפתאומיות לאפס. הרשת חווה הארה ועוברת משינון עיוור להבנה אמיתית והכללה מושלמת של חוקיות הנתונים.

כדי להבין מדוע זה קורה, ננסה לתאר את התופעה דרך חמש פרספקטיבות מתמטיות שונות שמשלימות זו את זו ומתארות את המנגנון הפנימי של הרשת ואולי אחת או יותר מהאנלוגיות הללו תעזורנה להבין את מה שקורה ואולי גם לקבל תחושה לגבי למה זה קורה.

תורת החבורות ותורת הייצוגים

כדי להבין את המבנה האלגברי, ניקח את הדוגמה הקלאסית שבה התגלה הגרוקינג: למידה של לוח הכפל או החיבור מודולו מספר ראשוני P (כלומר a + b ≡ c mod P). נתונים אלו מגדירים חבורה ציקלית. בשלב הראשון של האימון, הרשת מתייחסת למספרים כסמלים חסרי משמעות ופשוט בונה טבלת גיבוב פנימית כדי לשנן אילו קלטים מובילים לאיזה פלט. אולם, לשינון יש מחיר מבחינת מורכבות המשקולות. תורת הייצוגים מלמדת אותנו שקיימת דרך אלגנטית הרבה יותר לייצג חבורה ציקלית, דרך התמרת פורייה בדידה. כשהרשת עוברת למצב גרוקינג, היא למעשה מגלה ולומדת לייצג את המספרים כנקודות (או כזוויות) על גבי מעגל יחידה במישור המרוכב בתוך המרחב הלטנטי שלה. חיבור מודולרי הופך פשוט לסיבוב של זוויות (כפל של מספרים מרוכבים), מבנה רציף, מחזורי וסימטרי. הרשת מגלה את הסימטריה של החבורה, וכך יכולה לחשב תשובות גם עבור קלטים שלא ראתה מעולם.

מכניקה סטטיסטית

במונחים של פיזיקה של מערכות מרובות-חלקיקים, ניתן לראות את תהליך הלמידה במרחב המשקולות כמעבר פאזה פתאומי. בתחילת האימון המערכת נמצאת במצב נוזלי בעל אנטרופיה גבוהה; המשקולות מבולגנות ומאפשרות פתרונות מקומיים, שינון, שמאופיינים בתנודות גבוהות וללא סדר גלובלי. עם התקדמות זמן האימון, הלחץ המתמיד של האופטימיזציה מתפקד כקירור המערכת. לאורך אלפי עידני אימון, Epochs, המערכת מחפשת תצורה יציבה יותר בעלת אנרגיה נמוכה יותר, זאת אומרת, סיבוכיות נמוכה. הירידה הפתאומית בשגיאת הוולידציה מקבילה לנקודת הקיפאון וליצירת גביש, הרגע שבו כל המשקולות מסתדרות בבת אחת למבנה הרמוני, פשוט ומסודר שמתאר את החוקיות במלואה.

תורת הלמידה הסטטיסטית

כאן אנו בוחנים את ההטיה המשתמעת של אלגוריתמי הלמידה. גרוקינג נשען כמעט תמיד על קיומה של דעיכת משקולות (Weight Decay / L2 Regularization), שמוסיפה קנס על גודל המשקולות

||w||²

מבחינה סטטיסטית, פתרון של שינון דורש משקולות רבות, חזקות ומסובכות, ולכן הנורמה של משקולות הרשת גדולה מאוד. פתרון ההכללה, לעומת זאת, מבוסס על חוקיות פשוטה ולכן דורש משקולות קטנות ומעטות בהרבה, כלומר הנורמה קטנה משמעותית. כשאלגוריתם הגרדיאנט מגיע למינימום של פונקציית האימון, השינון, אין יותר גרדיאנט שנובע מהנתונים, השגיאה היא 0. בנקודה זו, הגרדיאנט היחיד שפועל הוא זה של דעיכת המשקולות, שמפעיל לחץ מתמיד לכווץ את המשקולות. לחץ זה דוחף לאט לאט את הרשת לחפש את אותו פתרון שמניב שגיאה 0 אבל דורש משקולות קטנות יותר, ובסופו של דבר מוצא את המבנה המכליל והפשוט.

תורת האינפורמציה

עקרון צואר הבקבוק של המידע מתאר היטב מדוע התהליך קורה בשלבים. הלמידה מתחלקת לשלב אגירת מידע ולשלב דחיסה. בשלב הראשון, הרשת מעלה במהירות את המידע ההדדי בינה לבין נתוני הקלט, היא אוגרת את הכל, כולל הרעש, תכונות לא רלוונטיות, והמיפוי הספציפי של דגימות האימון, זאת אומרת, שינון. לאחר מכן מגיע שלב הדחיסה הארוך. כשהרשת מנסה להקטין את עצימות המשקולות שלה, היא למעשה מוחקת מידע, המידע ההדדי עם הקלט יורד. היא מנסה לשכוח את המאפיינים הספציפיים והרעש, תוך כדי שהיא משמרת רק את המידע ההדדי שרלוונטי לפלט, זאת אומרת, את התשובה הנכונה. תהליך זיקוק המידע הזה מנקה את התבנית עד שנשאר רק החוק הטהור ביותר, הסיגנל, וזה מה שגורם להכללה לעבוד על נתונים חדשים.

אופטימיזציה רציפה

כדי להבין את ממד הזמן ואת השאלה למה זה לוקח כל כך הרבה זמן, עלינו לדמיין את פונקציית ההפסד כנוף טופולוגי במרחב רב-ממדי, שבו אנו מחפשים את הנקודה הנמוכה ביותר. מינימום השינון הוא כמו עמק רחב ושטוח שקל מאוד להתגלגל אליו מהאתחול האקראי. אולם, המינימום האמיתי של ההכללה נמצא בעמק צר ועמוק יותר, במיקום מרוחק. ברגע שהרשת נתקעת בעמק השינון

∇L = 0

ביחס לנתונים, ההתקדמות הופכת לסחיפה איטית ביותר על פני משטח כמעט ישר לחלון, המונעת על ידי SGD ועל ידי דעיכת המשקולות שמתווה שיפוע עדין מאוד. הרשת משוטטת באיטיות במרחב השטוח הזה במשך זמן רב, עד שהיא חוצה נקודת אוכף בלתי נראית, ונופלת בבת אחת מטה אל עבר התהום של מינימום ההכללה.

התנאים לקיום תופעת הגרוקינג?

ראשית, משימת הלמידה חייבת להכיל חוקיות יסודית שניתנת לייצוג קומפקטי, כמו לוגיקה, אלגברה מודולרית או סימטריות, שפשוט יותר מתמטית מהשינון העיוור של הנתונים. שנית, חייבים להשתמש ברגולריזציה, כי בלעדיה לא יהיה למודל שום כוח מניע או אינטרס לצאת מאזור השינון השטוח ולחפש משקולות חסכוניות יותר. שלישית, נדרש זמן אימון חריג באורכו. צריך להתעלם לחלוטין מחוק העצירה המוקדמת ולאפשר למודל להמשיך להשתנות גם כשהגרף מראה שגיאת אימון אפסית לחלוטין ולכאורה שום דבר לא קורה. רביעית, כמות נתוני האימון צריכה להיות בנקודת תורפה ספציפית: קטנה מספיק כדי לאפשר למודל לשנן הכל בהתחלה מבלי לקרוס, אך גדולה מספיק כדי שחוקיות הכללית אכן תהיה הפתרון המשתלם ביותר בסוף הדרך.

הרצון לחזות את התופעה החמקמקה הזו מראש במקום פשוט להמתין ולקוות מובנת. אף על פי שגרוקינג עשוי להיראות כמו קסם המופיע משום מקום, המנגנון מאחוריו מבוסס היטב בדינמיקה של למידה סטטיסטית. כדי לדעת האם מערכת מסוימת תחווה גרוקינג, איננו צריכים לנחש, עלינו לבחון את תכונות הנתונים, להגדיר נכון את שיטת הלמידה, ולעקוב אחר מדדים מתמטיים ספציפיים לאורך תהליך האופטימיזציה. ננסה להתייחס למה שידוע עד כה כדי להבין את התנאים לקיום התופעה.

אזור הזהבה

התנאי החיוני ביותר להופעת גרוקינג, שאותו עלינו להעריך מראש, הוא כמות נתוני האימון ביחס למורכבות המשימה. גרוקינג אינו מתרחש בכל גודל של מערך נתונים, אלא רק ברצועה צרה מאוד שמכונה, אזור הזהבה, Goldilocks Zone. זהבה מזהבה ושלושת הדובים, כן... כדי לדעת אם אנחנו באזור הזה, הדרך המקובלת היא לבצע ניסויים מקדימים עם חיתוכים שונים של הנתונים. אם נספק למודל מעט מדי נתונים, הוא ישנן אותם לחלוטין ושגיאת הוולידציה לעולם לא תרד, משום שאין מספיק מידע כדי שהכללה תהיה הפתרון המיטבי מתמטית. מנגד, אם נספק למודל שפע עצום של נתונים, הכללה תתרחש באופן מיידי ורציף כבר בתחילת האימון, ולא נראה את תופעת ההשהיה הארוכה שמאפיינת גרוקינג. אנו נדע שנקבל גרוקינג רק אם נוודא שכמות הנתונים קטנה מספיק כדי לעודד שינון התחלתי, אך גדולה מספיק כדי שהטופולוגיה של החוקיות הפנימית עדיין תהיה קיימת.

מדידת נורמת המשקולות והרגולריזציה

כדי שגרוקינג יתרחש, שיטת הלמידה חייבת לכלול מנגנון של דעיכת משקולות, שמוכר גם כרגולריזציית L2. המדד המרכזי שעלינו לנטר ברציפות כדי לחזות את בואו של הגרוקינג הוא הנורמה האוקלידית של משקולות הרשת, שמסומנת כ-

||w||²

בתחילת האימון, כאשר הרשת פונה לאסטרטגיית השינון הקלה, נראה את נורמת המשקולות מזנקת לערכים גבוהים. לאחר מכן, שגיאת האימון מתאפסת והגרדיאנט של הנתונים נעלם. בשלב ההמתנה הארוך והמייאש הזה, נראה ששום דבר לא קורה למדדי השגיאה, אך אם נביט בגרף של

||w||²,

נראה ירידה איטית, הדרגתית ועקבית. ירידה זו היא העדות המובהקת ביותר לכך שהמודל עובר תהליך של ניקוי וחיפוש אחר פתרון פשוט יותר. הירידה הפתאומית בשגיאת הוולידציה, זהו רגע הגרוקינג, תתרחש בדיוק בנקודה שבה נורמת המשקולות חוצה סף כלפי מטה.

ניתוח דרגת הייצוג וממדיות פנימית

מעבר למשקולות עצמן, אנו יכולים למדוד את הממדיות הפנימית של אקטיבציות הרשת בשכבות החבויות. על ידי חישוב מטריצת השונות המשותפת של הפלטים הפנימיים ובחינת הערכים העצמיים שלה, ניתן להעריך את הדרגה האפקטיבית של הייצוג. במצב של שינון, הייצוג הוא בעל דרגה גבוהה מאוד, כל דוגמת אימון נזרקת לכיוון שונה לחלוטין במרחב הלטנטי כדי להימנע מהתנגשויות. אם אנו מודדים את הדרגה האפקטיבית לאורך זמן ורואים שהיא מתחילה לקרוס ולדחוס את עצמה למספר קטן של ממדים משמעותיים, זהו איתות חזק לכך שהרשת גילתה את הסעפת דלת-הממדים של החוקיות, והגרוקינג קרוב מתמיד.

מתי נדע בוודאות שלא נקבל גרוקינג?

באותה שיטתיות, ישנם מצבים שבהם נוכל לפסול את התופעה מראש.

ראשית, אם אנו מנתחים את אוסף הנתונים ומבינים שאין בו מבנה אלגברי פשוט, סימטריה ברורה או חוקיות קומפקטית המייצרת את הנתונים, למשל, משימת סיווג תמונות עמוסה ברעש ובחריגים, המודל לא ימצא פתרון דחוס שיצדיק את נטישת השינון.

שנית, ברמת שיטת הלמידה, אם נבטל את דעיכת המשקולות ונסיר כל מנגנון רגולריזציה, מפורש או משתמע, נוכל להיות בטוחים שלא יקרה גרוקינג. ללא הקנס על גודל המשקולות המופעל על ידי הרגולריזציה, לפונקציית ההפסד אין שום שיפוע נוסף שדוחף אותה לצאת מעמק השינון. הרשת תישאר תקועה לנצח בפתרון המורכב ועתיר-המשקולות, שגיאת הוולידציה תישאר גבוהה, ונורמת המשקולות

||w||²

לא תרד לעולם.

לבסוף, אם במהלך האימון אנו מודדים את הגרדיאנטים ורואים שהם מתאפסים לחלוטין מכל הכיוונים, הן מהנתונים והן מהרגולריזציה, או שקצב הלמידה יורד מוקדם מדי לאפס, נדע שהדינמיקה קפאה על שמריה וששום מעבר פאזה לא יתאפשר.

עד כה בסיפורים, ועכשיו בפורמליזם מתמטי

המנגנון המדעי המדויק שמוביל לגרוקינג מוסבר באמצעות מסגרת מתמטית הקרויה תורת הלמידה הסינגולרית. בניגוד למודלים סטטיסטיים קלאסיים (רגולריים) שבהם קיימת נקודת מינימום מובהקת אחת שמסביבה הגיאומטריה היא ריבועית, רשתות עצביות עמוקות הן מודלים סינגולריים בעלי יתירות פרמטרית עצומה, שיוצרת יריעות טופולוגיות מנוונות במרחב פונקציית ההפסד. על פי תיאוריה זו, הדינמיקה האופטימיזטורית (האופן שבו אלגוריתמי אופטימיזציה משנים את הפרמטרים של מערכת לאורך זמן כדי להגיע לתוצאה מיטבית) אינה באמת תנועה אל עבר נקודה, אלא היא דגימה מתוך התפלגות בייסיאנית שמונעת על ידי מזעור של משתנה מצב שנקרא אנרגיה חופשית. האנרגיה החופשית המקומית, שמשקפת את ההסתברות של המערכת להימצא בסביבת משקולות ספציפית 𝑼 תחת מדגם בגודל 𝒏, מוגדרת מתמטית בקירוב על ידי הפיתוח האסימפטוטי הבא:

𝑭𝒏(𝑼) ≈ 𝒏𝑳𝒏(𝒘*) + 𝝀(𝒘*) log 𝒏 − (𝒎(𝒘*) − 𝟏) log log 𝒏

במשוואה זו, האיבר

𝑳𝒏(𝒘)*

הוא ההפסד האמפירי, שמכמת את שגיאת האימון האובייקטיבית על הנתונים. המשתנה

𝝀(𝒘)*

הוא מקדם הלמידה המקומי, מדד טופולוגי שמכמת את הרזולוציה, הניוון הגיאומטרי, והממד האפקטיבי של אגן ההפסד סביב המינימום.

בתחילת תהליך האימון, ערך ההפסד האמפירי

𝑳𝒏(𝒘)*

גבוה מאוד, ולכן איבר זה שולט באופן דומיננטי ומוחלט במשוואת האנרגיה החופשית. אלגוריתם SGD ממזער איבר זה במהירות האפשרית על ידי קריסה לתוך אגן השינון, שמאופיין בניצול מורכבות פרמטרית מקסימלית, וכפועל יוצא, בערך 𝝀 (מקדם למידה מקומי) גבוה מאוד. אולם, כאשר ההפסד האמפירי מתאפס הלכה למעשה

𝑳𝒏(𝒘) ≈ 𝟎*,

האיבר הראשון במשוואה מפסיק להפעיל גרדיאנט על המערכת. בשלב זה, הפער באנרגיה החופשית בין פתרונות אפשריים במרחב הופך להיות נשלט באופן בלעדי על ידי האיבר השני במשוואה,

𝝀(𝒘) log 𝒏*.

אגן ההכללה, שמבוסס על דחיסה אלגברית וניצול סימטריות (כמו למשל, חילוץ תדרים להתמרת פורייה בדידה במשימות מודולריות), מאופיין גיאומטרית בערך 𝝀 נמוך משמעותית.

מכיוון ש-SGD מהווה קירוב לאלגוריתם דגימה בעל נטייה מובנית להתכנס לאזורים בעלי הסתברות פוסטריורית גבוהה (שהם מתמטית האזורים בעלי האנרגיה החופשית הנמוכה ביותר), המערכת נדחפת תחת לחץ תרמודינמי רציף לנטוש את אזור ה-𝝀 הגבוה ולעבור לאזור ה-𝝀 הנמוך. מעבר מתמטי וסטטיסטי זה הוא בדיוק מה שמעורר את מעבר הפאזה מסדר ראשון שאנו מזהים כגרוקינג.

כוח תיאורטי-סטטיסטי זה נתמך באופן אופרטיבי על ידי תופעה טופולוגית שמוגדרת כמנגנון ה-LU. מנגנון זה מסביר את האינטראקציה החיונית בין שגיאות המודל לבין הנורמה האוקלידית של משקולותיו. המנגנון מתאר גיאומטריה שבה שגיאת האימון קורסת לתצורה של האות L ביחס לנורמה, בעוד שגיאת המבחן יוצרת פרבולה בצורת האות U. באגן השינון, המערכת נדחפת ימינה על הציר למשקולות בעלות נורמה עצומה. יישום מתמטי של רגולריזציית דעיכת משקולות מפעיל וקטור ענישה רציף ושלילי על המשקולות, שדוחף ומכווץ את הנורמה בחזרה מטה לאורך ציר ה-X אל תוך בסיס ה-U האופטימלי. תנועה וקטורית כפויה זו, בשילוב כוחות האנרגיה החופשית, מונעת מהרשת את האפשרות להשתהות באגן השינון ומבטיחה באופן אלגברי ודאי את ההתכנסות לאגן ההכללה, בו שתי השגיאות מינימליות.

נסביר את מנגנון LU

כדי להבין את מנגנון ה-LU בצורה הברורה ביותר, נדמיין גרף דו-ממדי פשוט. בציר האופקי אנו מודדים את גודל המשקולות של הרשת, או בשפה המקצועית, הנורמה של המשקולות. בציר האנכי אנו מודדים את גודל השגיאה של המודל. מנגנון ה-LU מתאר את ההתנהגות השונה לחלוטין של שגיאת האימון ושגיאת המבחן על גבי הגרף הזה.

עקומת שגיאת האימון (האות L)

נתחיל באות L, שמייצגת את מסלול שגיאת האימון. כאשר אנו מתחילים לאמן את הרשת, המשקולות גדלות והשגיאה צונחת מטה בחדות, מה שמייצר את הקו האנכי של האות L. ברגע שהרשת מצליחה לשנן את כל הנתונים, שגיאת האימון מגיעה לאפס. מנקודה זו והלאה, גם אם המשקולות ימשיכו לגדול ולהתנפח באופן ניכר (כלומר, תנועה ימינה על הציר האופקי), שגיאת האימון תישאר אפסית ושטוחה לחלוטין, מה שמייצר את קו האופקי של האות L.

עקומת שגיאת המבחן (האות U)

כעת נתבונן באות U, שמייצגת את מסלול שגיאת המבחן, שהיא למעשה היכולת של המודל להכליל לנתונים חדשים. בתחילת האימון, שגיאת המבחן יורדת גם היא עקב למידה התחלתית, אך מהר מאוד היא מגיעה לנקודת שפל, בסיס האות U. אם נאפשר למשקולות לגדול מעבר לאותה נקודה קריטית כדי לשנן את נתוני האימון בצורה עיוורת, המודל ייכנס למצב של התאמת-יתר חריפה. כתוצאה מכך, עקומת שגיאת המבחן תזנק בחדות כלפי מעלה ותושלם הצורה של האות U.

הדינמיקה שיוצרת גרוקינג

הפער הטופולוגי בין שתי הצורות הללו מסביר מדוע המודל נתקע, וכיצד רגולריזציה מצילה אותו. כאשר הרשת משננת, היא נמצאת הרחק ימינה על הגרף: על החלק האופקי והשטוח של ה-L (שגיאת אימון אפס) אך גבוה מאוד על הזרוע הימנית של ה-U (שגיאת מבחן עצומה). כאן נכנסת לפעולה דעיכת המשקולות. מנגנון זה פועל כמו קפיץ מתוח או כוח משיכה גיאומטרי קבוע, שמושך ודוחף את נורמת המשקולות בחזרה שמאלה, לכיוון האפס.

המשיכה הזו שמאלה מאלצת את המודל לנדוד לאחור על פני המישור השטוח של ה-L, עד שהוא נופל בדיוק אל תוך בסיס האות U. בנקודה הספציפית הזו, נורמת המשקולות קטנה ומדויקת, שגיאת האימון נשארת אפסית, אך כעת גם שגיאת המבחן נמצאת במינימום האפשרי שלה. זהו המצב של הכללה אופטימלית, והתנועה הגיאומטרית הזו על גבי הגרף היא בדיוק מה שמסביר ומזרז את מעבר הפאזה המכונה גרוקינג.

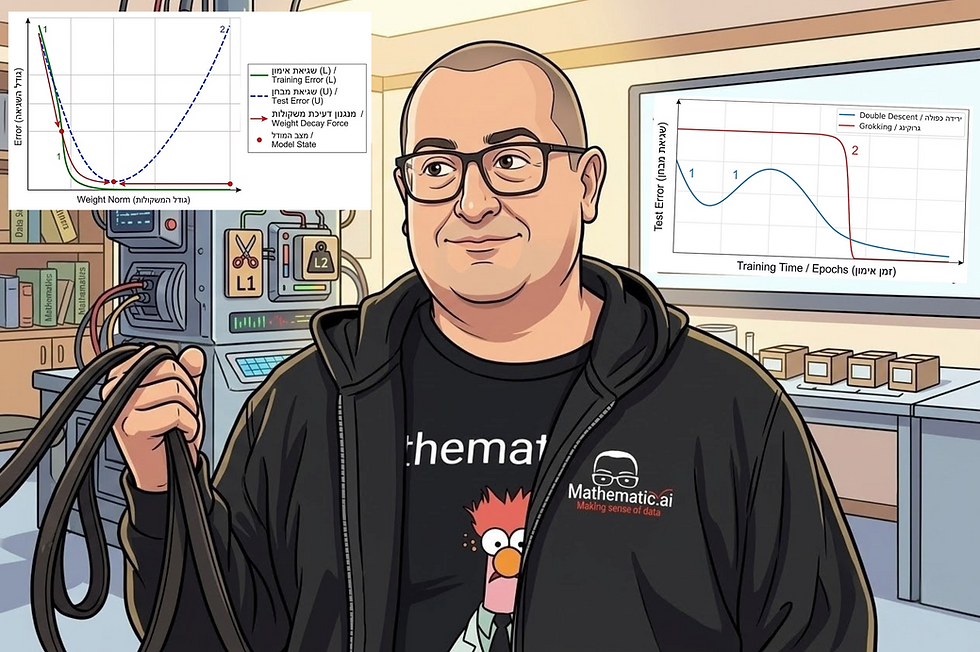

השווה והשונה שבין Grokking לבין Epoch-wise Double Descent

התופעות Grokking ו-Epoch-wise Double Descent (ירידה כפולה לאורך זמן האימון) אינן בדיוק אותה התופעה, אך הן בהחלט דודניות קרובות מאוד שמשתייכות לאותה משפחה של התנהגויות שאינן אינטואיטיביות בלמידת מכונה. שתיהן קוראות תיגר על הסטטיסטיקה הקלאסית ומוכיחות שהמשך אימון המודל, גם עמוק אל תוך האזור שנחשב כהתאמת-יתר, יכול להוביל בסופו של דבר להכללה טובה ויציבה יותר. עם זאת, יש ביניהן הבדלים מהותיים בצורת העקומה, בסוג המשימות, ובמכניקה העדינה שמובילה אליהן.

כדי להבין את קווי הדמיון, נסתכל על ציר הזמן של האימון. בשתי התופעות, המודל מפר לחלוטין את הכלל הקלאסי של עצירה מוקדמת. התיאוריה המסורתית גורסת שכאשר שגיאת האימון יורדת אך שגיאת המבחן מתחילה לטפס, חובה לעצור את האימון מיד כי המודל התחיל לשנן רעש. גם בגרוקינג וגם בירידה כפולה לאורך זמן האימון, אם מתעלמים מהכלל הזה ומאפשרים למודל להמשיך להשתנות לאורך זמן רב, שגיאת המבחן חוזרת לרדת. הקהילה המדעית נוטה להסביר את המכנה המשותף הזה באמצעות מסגרת של מהירויות למידה: מודלים נוטים ללמוד קודם כל תבניות מהירות ושטחיות שמובילות לשינון של מקרים פרטיים ולשגיאת מבחן גבוהה, ורק בשלב מאוחר יותר תחת לחץ האופטימיזציה, הם ממצים את למידת התבניות האיטיות והעמוקות שמניבות הכללה אמיתית לנתונים שמעולם לא נראו.

למרות קווי הדמיון החזקים, ההבדל הבולט והוויזואלי ביותר ביניהן טמון בצורת הגרף ובתזמון. ב-Epoch-wise Double Descent, עקומת שגיאת המבחן יורדת תחילה בשלבים המוקדמים, למידה של מאפיינים בסיסיים, לאחר מכן עולה ויוצרת מעין גבעה ברורה, שלב התאמת היתר ושינון הרעש, ולבסוף יורדת שוב באופן הדרגתי ככל שהרשת מרחיבה את יכולות הקידוד שלה לסיגנל האמיתי. לעומת זאת, גרוקינג מאופיין בהשהיה קיצונית ובמעבר פאזה דראסטי. בגרוקינג, לרוב אין ירידה ראשונית אלא קו שטוח; שגיאת המבחן נותרת גבוהה מאוד, לעיתים ברמת ניחוש אקראי לחלוטין, במשך אלפי מחזורי אימון לאחר ששגיאת האימון התאפסה. ואז, באופן פתאומי ובתוך חלון זמן קצרצר, השגיאה נופלת מצוק ישירות אל האפס. זו לא ירידה הדרגתית אלא קריסה טופולוגית.

הבדל מרכזי נוסף נוגע לאופי הנתונים ולמבנה הפתרון שמחפש המודל. תופעת הירידה הכפולה נצפית לרוב במשימות רגילות של למידה עמוקה על נתונים רועשים או תמונות מורכבות, והיא מתארת מעבר טבעי ממשקל יתר לרעש לעבר פתרון מאוזן ומכליל יותר. לעומת זאת, תופעת הגרוקינג מובהקת וטהורה בעיקר כאשר מדובר במשימות בעלות אופי אלגוריתמי מובהק. מדובר במשימות קטנות, סימטריות וסגורות, כגון לוגיקה או פעולות מודולריות. משימות אלו דורשות מהרשת למצוא חוקיות הרמטית ובלתי פריקה. בגרוקינג, ההכללה הפתאומית אינה החלקת הרעש כמו בירידה כפולה, אלא היא תוצאה של גילוי אלגוריתם מתמטי חדש לחלוטין במרחב הנסתר של הרשת, כגון אימוץ של כפל פורייה על פני תדרים מעגליים. במילים פשוטות, ירידה כפולה היא תהליך הדרגתי של זיקוק סיגנל מתוך רעש ויזואלי או טקסטואלי, בעוד שגרוקינג הוא רגע ה"אאוריקה" שבו המערכת ממציאה מחדש את המתמטיקה של הבעיה כדי להקטין את עצימות המשקולות שלה.

לסיכום

במאמר זה ניסיתי להציג את תופעת הגרוקינג בלמידת מכונה, להסביר מהי, מדוע היא פועלת וכיצד היא פועלת, להסביר מתי לצפות שתתרחש ועל סמך מה, ומתי אינה יכולה להתקיים ומדוע. ההסברים נעו בין תיאורים סיפוריים דרך דיסציפלינות מתמטיות שונות ואנלוגיות מהחיים לבין פורמליזם מתמטי. המאמר הזה הוא ניסיון כנה לתת את המשמעויות ולא רק את המכניקה וגם לא להוות עוד תיאור פופולרי שבעצם חוזר ומהדהד את אותם הניסוחים פחות או יותר מהמאמרים המקוריים ופורצי הדרך.

אנחנו ב- Mathematic.ai יודעים "להרים מכסה מנוע" במערכות לומדות, יודעים לתכנן ולבנות אותן מאפס, יודעים לשפר ולהאיץ אותן ויודעים להביא אותן לסקייל גבוה ולמצב בר-קיימא בפרודקשן. אנחנו מספקים שירותים של מחקר אלגוריתמי יישומי, מתודולוגיה של ניסויים, שיטות הערכה, אוטומציה של תהליכים.

דברו איתי:

שלמה יונה,

מייסד ומדען ראשי,

מתמטיקאי מחקר ופיתוח בע"מ

053-7326360

פודקאסט על החברה ועליי, שלמה יונה, ואופן העבודה שלנו ואיתנו:

.png)

Comments